Un chiffre qui frappe, un signal marché qui ne trompe pas

Dans l’économie des applications, une vague de désinstallations est souvent plus révélatrice qu’un simple ralentissement des téléchargements. Ici, le bond de 295% des uninstallations de ChatGPT agit comme un indicateur de perception : une partie des utilisateurs ne s’est pas contentée de commenter l’actualité, elle a posé un acte concret. Pour OpenAI, c’est un rappel brutal qu’un produit grand public peut être impacté par des décisions B2G (business-to-government), surtout lorsqu’elles touchent à des institutions sensibles comme le DoD.

Pourquoi l’accord DoD déclenche une onde de choc

Dans l’imaginaire collectif, “DoD” renvoie immédiatement à la défense, au renseignement, à la sécurité nationale et, par extension, à des usages potentiellement controversés des technologies. Même si un contrat gouvernemental peut viser des besoins variés — modernisation, productivité, cybersécurité, aide à l’analyse — la symbolique est puissante. Pour certains consommateurs, l’association entre ChatGPT et la défense américaine suffit à faire naître des inquiétudes autour de la confidentialité, de l’exploitation des données et des finalités réelles de l’IA.

La confiance, nerf de la guerre des IA génératives

Depuis l’explosion des modèles de langage, la confiance est devenue un avantage compétitif aussi important que la qualité des réponses. Les utilisateurs comparent, testent, migrent. Dans ce contexte, la hausse des désinstallations de ChatGPT après l’annonce de l’accord avec le DoD illustre une réalité du marché : la perception de la gouvernance, de l’éthique et de la transparence influence directement l’adoption. Autrement dit, l’expérience utilisateur ne se limite plus à l’interface ou aux performances ; elle englobe l’écosystème, les partenariats, et la manière dont une entreprise explique ce qu’elle fait — et ce qu’elle ne fait pas.

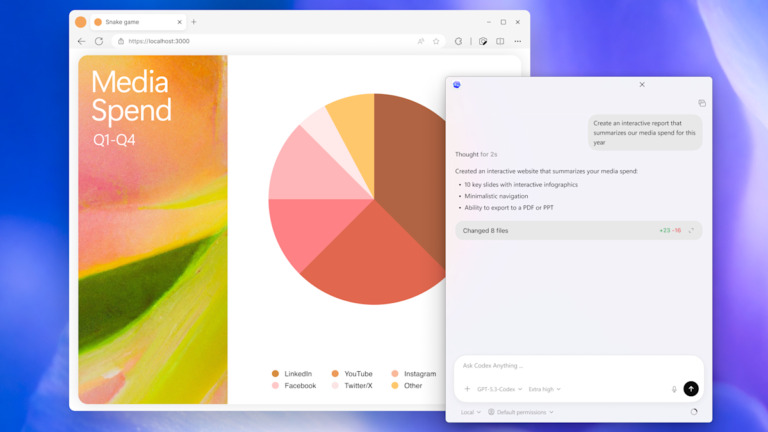

Claude profite de l’effet de bascule

Pendant que ChatGPT essuie ce revers d’image, Claude — concurrent de plus en plus visible sur le segment des assistants IA — a bénéficié d’une dynamique inverse, avec une hausse de ses téléchargements. Le phénomène est typique d’un marché en “switching cost” faible : installer une autre application prend quelques secondes, et la curiosité des utilisateurs fait le reste. Dans les cycles médiatiques rapides, l’actualité devient un accélérateur de parts de marché, surtout lorsque le public cherche une alternative perçue comme plus “neutre” ou plus alignée avec ses attentes.

Un débat plus large : données, contrôle et souveraineté numérique

Au-delà d’OpenAI, l’épisode met en lumière des tensions structurelles autour de l’IA générative : qui contrôle les modèles ? Quels garde-fous encadrent les usages ? Où vont les données ? Les consommateurs sont de plus en plus sensibles à ces questions, notamment après des années de controverses liées aux plateformes numériques. Le mot-clé “DoD” agit ici comme un déclencheur émotionnel, mais le sujet de fond concerne l’équilibre entre innovation technologique, sécurité nationale et droits numériques.

Un risque réputationnel pour les marques grand public

Pour les entreprises tech, signer des contrats institutionnels peut être une étape stratégique — crédibilité, revenus, accès à des cas d’usage complexes. Mais lorsqu’un produit vise aussi le grand public, le risque réputationnel devient une variable centrale. L’affaire rappelle que la communication de crise et la pédagogie sont essentielles : expliquer les périmètres, clarifier les politiques de confidentialité, distinguer les environnements (grand public vs entreprise vs gouvernement), et détailler les mécanismes de conformité. À défaut, le vide est rapidement comblé par des interprétations et des narratifs viraux.

Le marché de l’IA entre accélération et polarisation

Le secteur de l’intelligence artificielle avance à un rythme qui laisse peu de place à l’ambiguïté. Les géants multiplient les annonces, les startups affûtent leurs promesses, et les utilisateurs arbitrent en temps réel. Cet épisode “désinstallations ChatGPT” montre une polarisation croissante : d’un côté, une adoption massive portée par la productivité et la création de contenu ; de l’autre, une défiance alimentée par les questions d’éthique, de surveillance et d’alignement. Dans ce climat, chaque partenariat devient un test grandeur nature.

Ce que OpenAI devra prouver maintenant

La suite dépendra moins des chiffres ponctuels que de la capacité d’OpenAI à restaurer, expliquer et rassurer. Les utilisateurs attendent de la transparence sur la séparation des données, les conditions d’utilisation, et la manière dont les contrats gouvernementaux s’articulent avec un service utilisé au quotidien par des millions de personnes. L’enjeu est clair : dans l’économie de l’attention, la confiance se gagne au long cours, mais peut se perdre en une notification. Et sur un marché où Claude et d’autres alternatives progressent, la compétition se joue autant sur la performance que sur la perception.