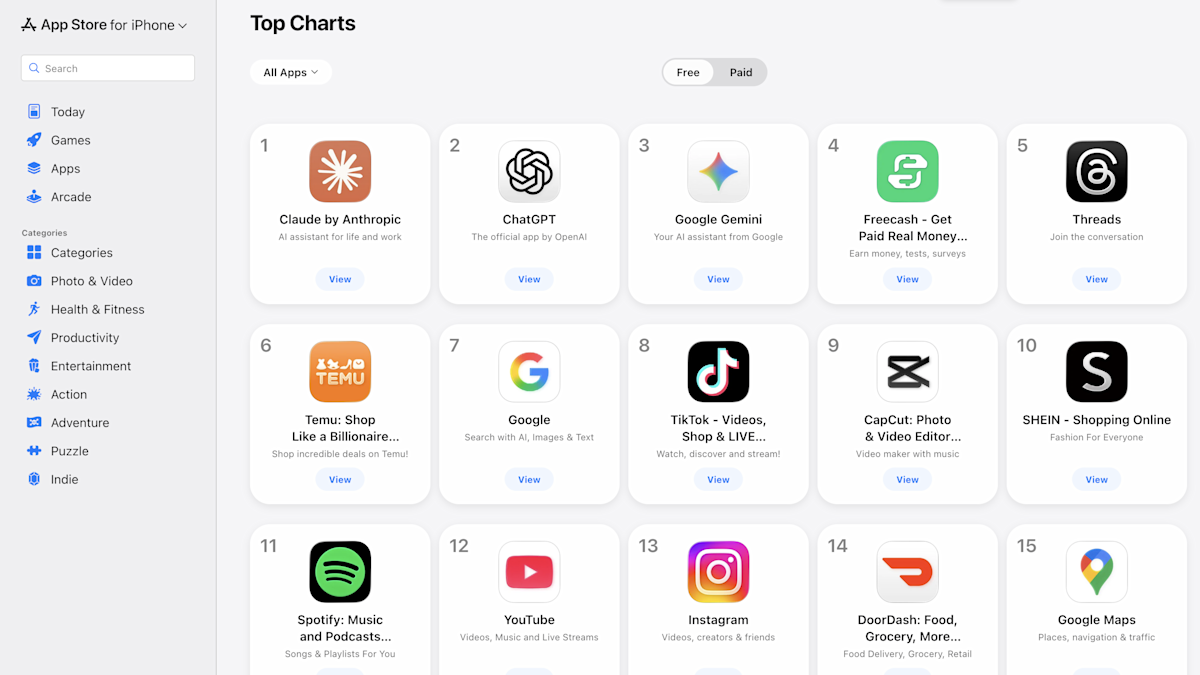

Claude يعتلي قائمة “Top Free Apps” على iPhone

على لوحة “Top Free Apps” في App Store داخل الولايات المتحدة، جاء Claude في المركز الأول، بينما تراجع ChatGPT إلى المركز الثاني، وحل Google Gemini ثالثاً. هذا التغير السريع في الترتيب لا يُقرأ كخبر “ترند” فقط، بل كإشارة إلى أن سوق التوزيع والاكتساب أصبح ساحة حسم في اقتصاد التطبيقات القائمة على الذكاء الاصطناعي. فمع تزايد التشابه الظاهري بين روبوتات الدردشة، باتت القناة التي يصل عبرها المنتج إلى المستخدم—ومتانة العلامة التجارية—لا تقل أهمية عن قوة النموذج نفسه.

قرار Trump يشعل “Streisand Effect” ويرفع التنزيلات

الارتفاع الحاد في التنزيلات لم يكن نتيجة “صدفة خوارزمية”. جاء مباشرة بعد إعلان أن الرئيس Trump أصدر توجيهاً للوكالات الفيدرالية بوقف استخدام Claude وغيرها من أدوات Anthropic. ووفقاً للمعلومات المتداولة، يرتبط الخلاف بمستوى “guardrails” أو ضوابط الأمان التي رفضت Anthropic تخفيفها. هنا ظهر ما يسميه خبراء الاقتصاد الرقمي بـ“Streisand Effect”: محاولة تقييد الوصول إلى خدمة أو منعها قد تؤدي عملياً إلى تضخيم الاهتمام بها، وتوسيع النقاش حولها، ثم تحويل هذا الاهتمام إلى تنزيلات وتجربة فعلية من الجمهور.

خطوط حمراء لدى Anthropic: مراقبة جماعية وأسلحة ذاتية بالكامل

في قلب النزاع، تقف فلسفة Anthropic حول الاستخدام “المقبول” لتقنيات الذكاء الاصطناعي. فبحسب ما ورد، رفضت الشركة أن تُستخدم نماذجها في المراقبة الداخلية واسعة النطاق، أو في أسلحة مستقلة بالكامل دون تدخل بشري فعّال. هذا الموقف—المقدم كخيار حوكمة وأخلاقيات—وضعها على مسار تصادمي مع أجزاء من المنظومة الدفاعية الأمريكية التي تتسارع فيها شهية المؤسسات لقدرات أكثر قوة وتكاملاً. وبهذا، أصبح Claude رمزاً غير مقصود لنقاش أكبر: هل ينبغي للذكاء الاصطناعي أن يكون “قابلاً للتكييف” بلا حدود، أم أن وجود قيود صريحة هو شرط أساسي للثقة العامة؟

Pentagone يلوّح بتصنيف “supply-chain risk” وتداعياته

التوتر تصاعد أكثر بعد تهديد وزير الدفاع Pete Hegseth بتوصيف Anthropic على أنها “supply-chain risk”. هذا النوع من التصنيفات في البيئة الفيدرالية لا يُعد تفصيلاً إجرائياً؛ بل يمكن أن يؤثر في الثقة المؤسسية، وقرارات الشراء الحكومية، وحتى نظرة الشركاء من القطاع الخاص، خصوصاً في القطاعات المنظمة والحساسة. بالنسبة لـAnthropic، القضية لم تعد خسارة عميل كبير فحسب، بل أصبحت معركة حول السمعة والامتثال ومعايير الأمان التي ستُستخدم لاحقاً لقياس أهلية شركات الذكاء الاصطناعي في المناقصات والسياسات الأمنية.

OpenAI تملأ الفراغ: “realpolitik” الذكاء الاصطناعي

بينما يتم استبعاد Anthropic، تشير المعلومات إلى أن OpenAI “أخذت مكانها” عبر قبول اتفاق مع Department of Defense. هذا التحول يسلط الضوء على حقيقة باتت أكثر وضوحاً: السوق الحكومي ليس هامشياً، بل محرك نمو يوازي سوق الشركات الكبرى—وأحياناً يتفوق عليها من حيث الاستمرارية والميزانيات. كما يكشف عن “realpolitik” الذكاء الاصطناعي: ليست جودة النموذج وحدها من يحدد الفرص، بل أيضاً شروط الاستخدام، والمواءمة، والسيادة التقنية، ومتطلبات الأمن القومي.

Sam Altman ينتقد الحظر ويحذر من سابقة “مخيفة”

اللافت أن Sam Altman، الرئيس التنفيذي لـOpenAI ومنافس Anthropic المباشر، علّق علناً على القضية خلال تفاعل (AMA) على X. Altman وصف توصيف “supply-chain risk” ضد Anthropic بأنه “قرار سيئ جداً”، وأعرب عن أمله في إلغائه، محذراً من “سابقة شديدة الإخافة” حين يصبح إغلاق السوق ممكناً بهذه السرعة بسبب خلاف حول “guardrails”. هذه التصريحات تتجاوز المنافسة التجارية لتكشف قلقاً أوسع داخل الصناعة: إذا كان الوصول إلى السوق قد يُقطع بقرارات سياسية غير شفافة، فقد يصبح الابتكار نفسه رهينة لتوازنات السلطة لا لمعايير واضحة يمكن التنبؤ بها.

لماذا تصدر App Store مهم لمنظومة الذكاء الاصطناعي؟

المرتبة الأولى على App Store ليست مجرد وجاهة. إنها مؤشر traction قوي ينعكس على الظهور، والاكتساب العضوي، وتجربة المستخدمين على نطاق واسع. في سوق مكتظ بروبوتات الدردشة، يمثل التصنيف واجهة دائمة تجذب مستخدمين يقارنون بين Claude وChatGPT وGoogle Gemini، ويختبرون الاستخدامات اليومية مثل الكتابة، والبحث، والتلخيص، والإنتاجية—ثم ينتقلون أحياناً إلى الاشتراكات المدفوعة. بالنسبة لـAnthropic، هذا الزخم قد يعزز تموضعها كخيار يرتكز على السلامة والموثوقية والضوابط الصريحة في زمن تتزايد فيه المخاوف حول الانفلات والاستخدامات عالية المخاطر.

إشارة أوسع: الذكاء الاصطناعي صار منتجاً جماهيرياً وساحة سياسية

هذه الحلقة تؤكد تحولاً حاسماً: الذكاء الاصطناعي لم يعد مجرد تقنية، بل ملف حوكمة وسياسات. السؤال لم يعد “أي نموذج الأفضل؟” فقط، بل “من يحق له استخدامه، ولأي غرض، وتحت أي شروط؟”. وبينما دفعت إدارة Trump بـClaude إلى قلب جدل فيدرالي، جاءت الاستجابة الشعبية بأبسط فعل في اقتصاد التطبيقات: التنزيل. هكذا تحولت أزمة مؤسساتية إلى فوز توزيع على App Store—وإلى درس جديد في أن معارك الذكاء الاصطناعي تُحسم أحياناً في السياسة… ثم تُترجم فوراً إلى أرقام على شاشة iPhone.