Une mémoire activable pour des réponses plus cohérentes

Concrètement, lors d’une prochaine conversation avec Claude, les utilisateurs verront apparaître une option leur permettant d’autoriser l’IA à référencer des discussions passées. L’objectif est simple : éviter de répéter le contexte, conserver des préférences (style d’écriture, objectifs, contraintes), et proposer une expérience plus fluide, proche d’un “assistant” au long cours. Dans un marché où la personnalisation devient un facteur de rétention majeur, la “mémoire” n’est plus un luxe, mais un standard en construction.

De la fonctionnalité payante à l’accès grand public

Anthropic avait introduit la capacité de Claude à se souvenir des interactions en août dernier, avant de renforcer le système à l’automne avec une approche de compartimentation des souvenirs. Cette logique vise à mieux organiser ce que l’IA retient, afin d’éviter des mélanges de contexte entre sujets distincts (par exemple, séparer une discussion professionnelle d’une demande créative ou personnelle). Le passage au plan gratuit marque donc une inflexion : la mémoire devient un levier d’adoption massive, et non plus seulement un argument d’abonnement.

Un timing calculé : importer ses conversations depuis un concurrent

Cette ouverture de la mémoire intervient au moment où Anthropic facilite aussi l’importation d’historiques de conversations depuis un chatbot concurrent vers Claude. Le message est clair : réduire au maximum les frictions de migration. Pour l’utilisateur, c’est la promesse de retrouver rapidement ses repères (projets en cours, prompts récurrents, préférences) et de transformer un simple test en adoption durable. Sur le plan SEO et produit, la combinaison “import d’historique + mémoire gratuite” est un duo puissant : elle vise les requêtes liées au transfert de données, à la continuité conversationnelle et à l’assistant IA personnalisé.

Contrôle et confidentialité : pause ou suppression des souvenirs

Anthropic met en avant une gestion flexible : si l’utilisateur active la mémoire puis décide de la désactiver, deux choix sont proposés. Il est possible de “mettre en pause” la fonctionnalité, afin de préserver les souvenirs pour une réutilisation ultérieure, ou de les supprimer entièrement pour qu’ils ne restent pas stockés sur les serveurs d’Anthropic. Dans un contexte où la confidentialité, la gouvernance des données et la transparence des IA génératives sont au centre des débats, cette granularité de contrôle devient un argument décisif, notamment pour les utilisateurs soucieux de la protection de leurs données personnelles.

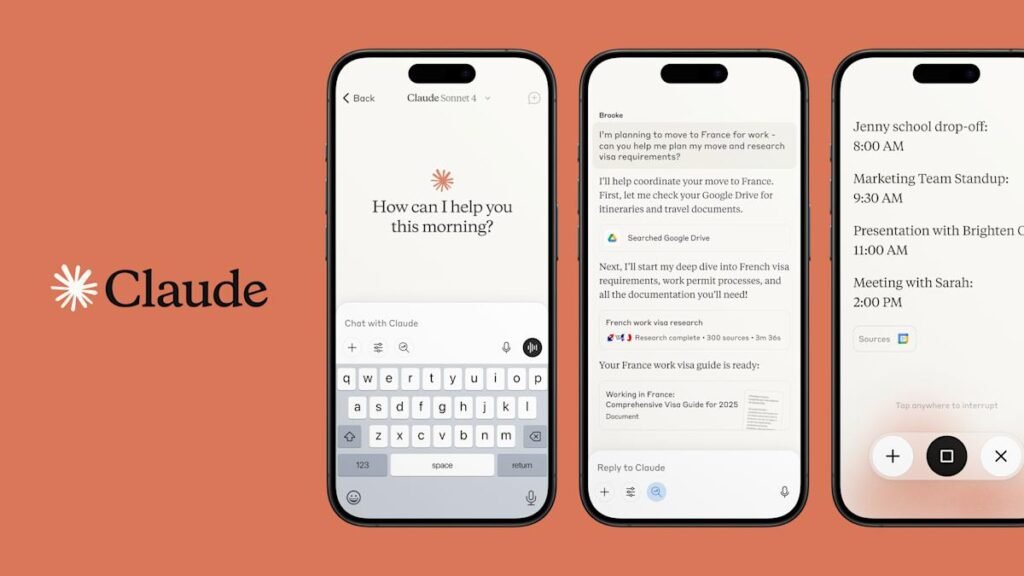

Claude en pleine ascension : la dynamique App Store

Cette annonce arrive alors que Claude bénéficie d’une visibilité accrue : l’application a récemment atteint la première place du classement des apps gratuites sur l’App Store. Ce signal n’est pas anodin. Dans l’économie des plateformes, le “top chart” agit comme une rampe de lancement : plus d’installations, plus de tests, plus de bouche-à-oreille. Et dans l’univers des assistants IA, la valeur se construit souvent par l’usage répété — exactement ce que la mémoire vient amplifier en rendant l’expérience plus utile dès les premiers jours.

Une entreprise sous pression : dispute contractuelle avec le gouvernement américain

En parallèle de ces avancées produit, Anthropic traverse une zone de turbulences politiques. L’entreprise est engagée dans un différend contractuel à forts enjeux avec le gouvernement des États-Unis, lié aux garde-fous de l’IA. Le secrétaire à la Défense, Pete Hegseth, a qualifié Anthropic de “risque pour la chaîne d’approvisionnement” après que la société a refusé de signer un contrat qui aurait permis l’usage de ses modèles par le Pentagone dans des scénarios incluant de la surveillance de masse d’Américains et des armes entièrement autonomes. Anthropic a annoncé vouloir contester cette désignation, tandis que le secteur attend de voir les conséquences potentielles sur ses partenariats, son accès à certains marchés et sa réputation institutionnelle.

Pourquoi la mémoire gratuite change la donne sur le marché de l’IA

Derrière l’annonce, un enjeu se dessine : la bataille ne se joue plus uniquement sur la qualité brute des réponses, mais sur la continuité, l’intégration et l’expérience utilisateur. Offrir la mémoire dans le plan gratuit pousse les concurrents à suivre, et élève les attentes du public : un assistant IA conversationnel doit “se souvenir” pour être réellement productif. Pour Anthropic, c’est aussi une manière d’aligner croissance et différenciation : plus d’utilisateurs, plus d’engagement, et une proposition de valeur renforcée face aux alternatives.

La suite : adoption, confiance et arbitrages réglementaires

Entre montée en puissance de Claude et tensions avec les autorités américaines, Anthropic joue sur deux tableaux : l’innovation orientée utilisateur et la démonstration de responsabilité. La mémoire, en particulier, cristallise ces deux dimensions : elle améliore l’expérience tout en exigeant une politique solide de contrôle, de suppression et de transparence. Dans les semaines à venir, l’évolution de cette fonctionnalité — et la manière dont l’entreprise gère la confiance — pourrait peser autant que les performances du modèle lui-même.