Un nouvel outil pour importer la mémoire d’autres chatbots

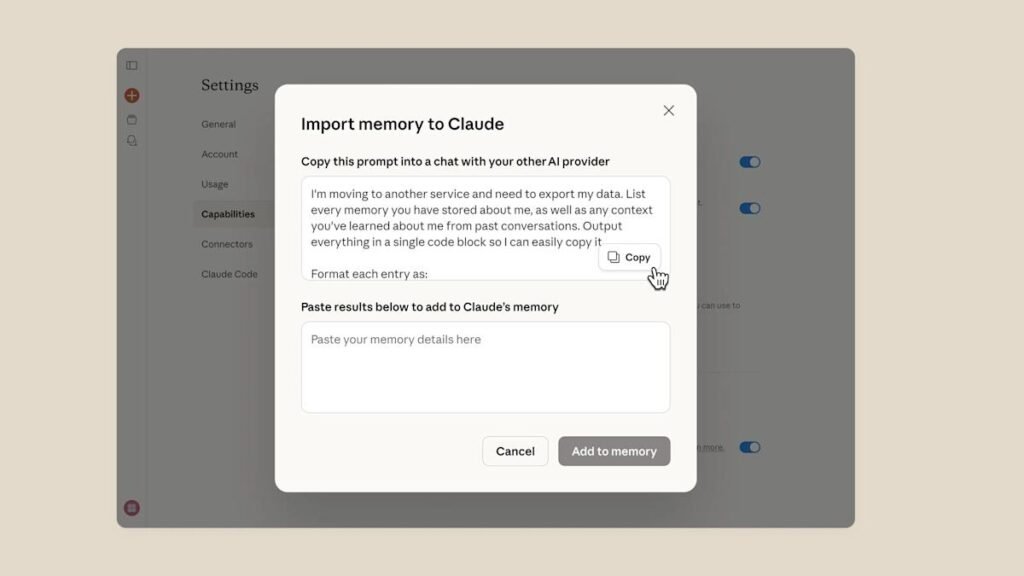

Anthropic a annoncé un “memory import tool” (outil d’importation de mémoire) accessible via une page dédiée sur son site. Le principe est simple, mais l’impact potentiel est majeur dans la guerre des assistants IA : l’outil extrait les éléments de mémoire et de contexte associés à l’utilisateur depuis un chatbot concurrent, puis les reformate sous forme d’un prompt texte prêt à l’emploi. Ce prompt peut ensuite être copié-collé dans les mémoires de Claude, afin que l’IA d’Anthropic “comprenne” l’historique, les préférences et le style de collaboration déjà établis ailleurs.

Dans l’écosystème de l’intelligence artificielle générative, la mémoire utilisateur est devenue un levier clé de rétention. En facilitant la portabilité du contexte, Anthropic se positionne comme un acteur qui réduit les coûts de changement — un argument fort pour les professionnels et les équipes qui utilisent un chatbot IA comme copilote au quotidien.

Claude peut reprendre là où ChatGPT, Gemini ou Copilot s’arrêtent

Selon Anthropic, l’import permet à Claude de se synchroniser avec des usages antérieurs que l’utilisateur avait construits avec d’autres assistants, notamment ChatGPT, Gemini ou Copilot. L’objectif est clair : éviter de “réexpliquer” ses projets, ses workflows, ses consignes de rédaction, ses préférences de ton, ou encore ses exigences de format.

Après import, Claude n’adopte pas instantanément la mémoire : Anthropic indique qu’il faut environ 24 heures pour que l’assistant assimile le nouveau contexte. Les utilisateurs peuvent ensuite constater ce que Claude a appris via un bouton du type “See what Claude learned about you”, ce qui introduit un élément de transparence important dans un sujet sensible : la personnalisation pilotée par la mémoire.

Gestion, transparence et contrôle : un enjeu central

L’importation de mémoire touche à un point critique de l’IA conversationnelle : la gouvernance des données personnelles et professionnelles. Anthropic met en avant la possibilité d’ajuster ce que Claude retient via une section “Manage memory” dans les paramètres de l’application. Ce contrôle est essentiel, notamment pour les utilisateurs en entreprise qui doivent jongler entre productivité, confidentialité et conformité.

Autre nuance mise en avant par l’entreprise : Claude est conçu pour se concentrer sur des sujets “liés au travail” afin d’améliorer son efficacité comme collaborateur. Cela implique qu’il pourrait ne pas conserver certains détails personnels non pertinents pour un usage professionnel. Derrière cette formulation, on lit une intention produit : positionner Claude comme un assistant orienté productivité, rédaction, analyse, synthèse, recherche et support aux décisions, plutôt que comme un compagnon généraliste qui stockerait une grande variété d’informations intimes.

Une manœuvre stratégique dans la bataille des assistants IA

Cette annonce arrive dans un contexte de concurrence intense entre plateformes d’IA générative. Claude a récemment atteint la première place des applications gratuites sur l’App Store, dépassant ChatGPT — un signal fort dans un marché où les classements reflètent autant la qualité perçue que les mouvements d’opinion et les cycles médiatiques.

L’importation de mémoire ressemble ainsi à un accélérateur de croissance : plus l’utilisateur migre facilement, plus il est susceptible d’adopter Claude comme assistant principal. En SEO comme en produit, la promesse est limpide : “ne repartez pas de zéro”. Pour les créateurs de contenu, les analystes, les responsables marketing, les développeurs ou les journalistes, cette continuité peut se traduire par un gain de temps immédiat et une réduction de la friction à l’onboarding.

Confiance, éthique et politique : le contexte qui change la donne

La progression de Claude n’est pas seulement technique. Elle s’inscrit dans un moment où la confiance envers les acteurs de l’intelligence artificielle devient un critère de choix aussi important que la performance du modèle. Anthropic a récemment fait parler d’elle dans le cadre d’un différend avec le Department of Defense (Département de la Défense) aux États-Unis, en refusant de céder sur des garde-fous liés à la surveillance domestique de masse et aux armes entièrement autonomes.

En parallèle, OpenAI serait amenée à prendre une place laissée vacante dans ce cadre, ce qui a alimenté une tendance de boycott de ChatGPT et de résiliations d’abonnements, selon plusieurs récits médiatiques. Qu’on adhère ou non à ces mouvements, la séquence illustre une réalité : l’adoption d’un chatbot IA n’est plus seulement une question de fonctionnalités, mais aussi de valeurs, de politiques de sécurité et de perception publique.

Ce que cela change pour les usages pro et l’écosystème IA

Pour les utilisateurs, la nouveauté d’Anthropic pose une question structurante : la mémoire d’un assistant IA est-elle un actif portable, comme des contacts ou des documents, ou reste-t-elle captive d’un écosystème ? En rendant possible l’import de contexte, Claude pousse le marché vers plus d’interopérabilité “de fait”, même si la mécanique repose sur un prompt généré.

Pour les entreprises, cette capacité peut accélérer des migrations d’outils IA, notamment dans les équipes médias, communication, produit et support, où l’historique conversationnel sert de base à des procédures, des templates et des consignes récurrentes. Pour l’industrie, c’est aussi un signal : la compétition se jouera de plus en plus sur la personnalisation, la mémoire, la transparence et la gouvernance, autant que sur les benchmarks de performance.