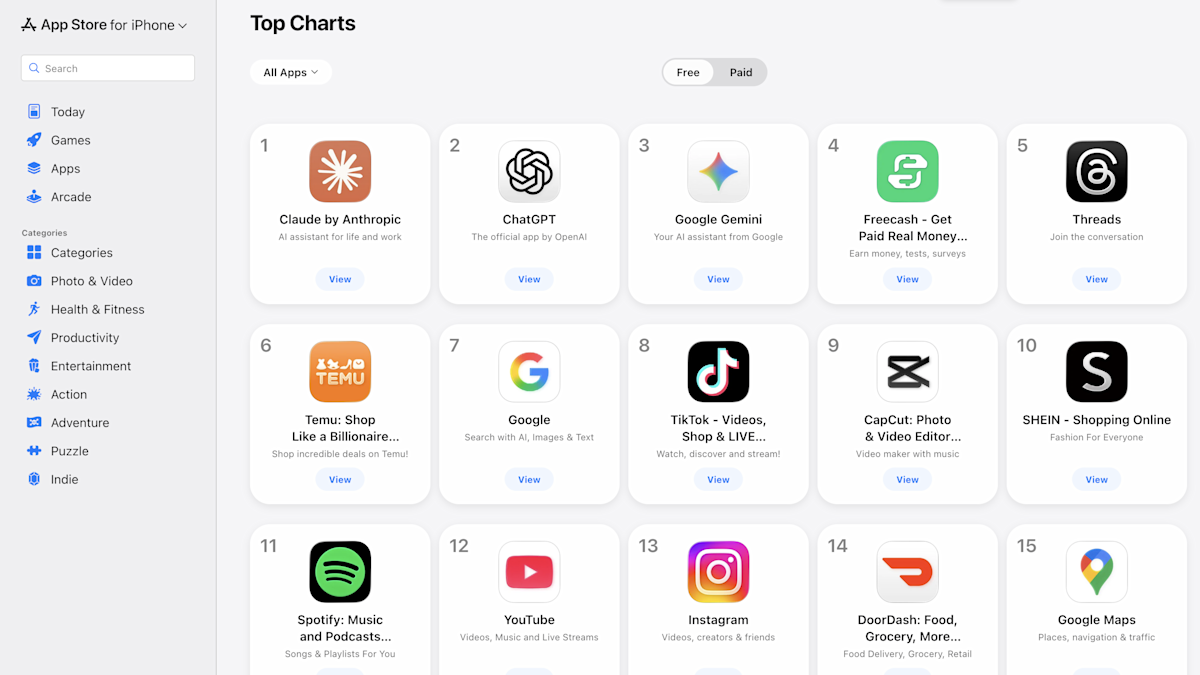

Claude prend la tête des applications gratuites sur iPhone

Sur le tableau de bord « Top Free Apps » d’Apple aux États-Unis, Claude s’est hissé à la première place, devant ChatGPT (2e) et Google Gemini (3e). Pour Anthropic, l’effet est double: d’un côté, l’entreprise perd potentiellement un accès stratégique au marché fédéral; de l’autre, elle récolte une visibilité grand public inédite, dopée par un effet de solidarité et de curiosité. Dans un secteur où la bataille de la distribution est aussi décisive que la performance des modèles, cette position sur l’App Store est un signal fort: l’IA conversationnelle se consomme désormais comme un produit grand public, au même titre que les réseaux sociaux ou les outils de productivité.

Une hausse des téléchargements liée à la décision de Trump

Cette envolée n’a rien d’un hasard algorithmique. Elle intervient juste après l’annonce que le président Trump a ordonné aux agences fédérales de cesser d’utiliser Claude, ainsi que d’autres outils d’Anthropic. Selon les informations rapportées, la rupture découle d’un désaccord sur des « garde-fous » (guardrails) que l’entreprise a refusé d’assouplir. Résultat: l’affaire a rapidement pris une dimension médiatique, alimentant un phénomène classique de l’économie numérique — l’« effet Streisand » — où la tentative de restriction peut amplifier l’attention, la discussion et, in fine, l’adoption.

Anthropic refuse certaines utilisations: surveillance de masse et armes autonomes

Au cœur du conflit, une ligne rouge assumée par Anthropic: l’entreprise aurait décliné l’idée que ses modèles soient utilisés pour de la surveillance domestique de masse et pour des armes entièrement autonomes. Cette posture, présentée comme un choix de gouvernance et d’éthique de l’IA, a cristallisé une opposition avec l’appareil de défense américain. Dans ce bras de fer, Claude est devenu malgré lui un symbole: celui d’une IA qui revendique des limitations d’usage, à l’heure où la demande institutionnelle et militaire pour des systèmes toujours plus puissants s’accélère.

Le Pentagone brandit le risque « supply-chain »

La tension a franchi un cap supplémentaire lorsque le secrétaire à la Défense, Pete Hegseth, a menacé Anthropic d’une désignation de « supply-chain risk » (risque de chaîne d’approvisionnement). Ce type d’étiquette, dans l’écosystème fédéral, peut peser lourdement: elle influence la confiance, les achats publics, et peut contaminer la perception de partenaires privés, notamment dans les secteurs régulés. Pour Anthropic, l’enjeu ne se limite donc pas à l’accès à un client: c’est une bataille de crédibilité et de conformité, avec des implications directes sur la manière dont l’IA générative est évaluée dans les appels d’offres et les politiques de sécurité.

OpenAI récupère le contrat: la realpolitik de l’IA

Pendant qu’Anthropic est écarté, OpenAI aurait « pris la place » en acceptant un accord avec le Département de la Défense. Le message est clair: dans la course à l’IA, le marché gouvernemental représente un relais de croissance majeur, au même titre que l’entreprise. Cette bascule illustre la realpolitik de l’IA générative: l’alignement des modèles, les conditions d’usage, la souveraineté technologique et la sécurité nationale deviennent des variables de négociation aussi déterminantes que la qualité du modèle lui-même.

Sam Altman critique l’interdiction et évoque un précédent inquiétant

Fait notable, Sam Altman, CEO d’OpenAI et concurrent direct d’Anthropic, a publiquement commenté l’affaire lors d’un échange en ligne (AMA) sur X. Il a qualifié la désignation « supply-chain risk » visant Anthropic de « très mauvaise décision » et dit espérer qu’elle soit annulée. Altman a aussi parlé d’un « précédent extrêmement effrayant » en référence à la mise sur liste noire. Au-delà de la rivalité commerciale, ces mots traduisent une crainte partagée dans l’industrie: si l’accès au marché peut être coupé brutalement pour des raisons de désaccord sur les garde-fous, l’innovation pourrait se retrouver davantage conditionnée par des arbitrages politiques que par des standards transparents.

Pourquoi ce classement App Store compte pour l’écosystème IA

Devenir l’application gratuite numéro 1 sur l’App Store ne relève pas seulement du prestige. C’est un indicateur de traction, qui impacte la visibilité, la rétention et l’acquisition organique. Dans un marché saturé de chatbots et d’assistants IA, le classement agit comme une vitrine: il attire des utilisateurs qui comparent Claude, ChatGPT et Gemini, testent les usages (rédaction, recherche, résumés, productivité) et, parfois, basculent ensuite vers des offres premium. Pour Anthropic, ce momentum peut aussi renforcer sa marque autour d’une promesse différenciante: une IA axée sur la sécurité, la fiabilité et des garde-fous assumés.

Un signal plus large: l’IA, champ de bataille politique et produit grand public

L’épisode illustre un tournant: l’intelligence artificielle n’est plus seulement une technologie, c’est un sujet de gouvernance. La question n’est pas uniquement « quel modèle est le meilleur ? », mais « à quelles conditions peut-il être utilisé, par qui, et pour quoi faire ? ». En plaçant Claude au centre d’une controverse fédérale, l’administration Trump a involontairement propulsé l’application dans une nouvelle dimension médiatique. Et le public, lui, a répondu par l’acte le plus simple — télécharger — transformant un conflit institutionnel en victoire de distribution sur l’App Store.